AIUC-1: Il Nuovo Standard d'Oro per l'IA Aziendale Affidabile

Colmare il divario di fiducia nella CX: IA responsabile con AIUC-1

Immagina un direttore CX, Maria, in una tesa videochiamata con il CEO. "La settimana scorsa il nostro chatbot IA ha identificato erroneamente un cliente VIP e gli ha accidentalmente inviato via email il listino prezzi di un concorrente," sbotta il CEO. I dati sono trapelati; la fiducia del cliente è distrutta. Nel caos che ne segue, l'IT incolpa il prodotto, il prodotto incolpa il legale, e il team marketing non è nemmeno sicuro di cosa sia successo. Maria si rende conto dolorosamente che team isolati e implementazioni IA accelerate hanno lasciato indefiniti i parametri critici di dati e privacy – e ora la reputazione del suo brand è appesa a un filo.

Questo scenario non è finzione. Mentre chatbot IA, agenti vocali e motori di raccomandazione invadono i punti di contatto con i clienti, errori e pratiche opache sui dati possono distruggere la fiducia da un momento all'altro. Le aziende affrontano un chiaro dilemma: l'IA promette iper-personalizzazione ed efficienza, ma gli errori (risposte allucinatorie, uso non autorizzato di dati, fughe di proprietà intellettuale) possono danneggiare irreparabilmente l'esperienza del cliente. I leader CX ed EX hanno bisogno di un nuovo manuale – un framework strutturato per governare l'IA in modo responsabile.

Approfondimenti chiave:

- Fiducia a rischio: I fallimenti dell'IA (come risposte sbagliate sicure o fughe di dati) erodono direttamente la fiducia e la fedeltà dei clienti. I sondaggi mostrano che il 53% dei consumatori teme che i propri dati personali vengano utilizzati impropriamente dall'IA, e quasi la metà condividerebbe più dati solo se le aziende fornissero maggiore trasparenza e controllo.

- Primo standard per agenti IA: AIUC-1 è il primo standard completo al mondo per agenti IA, sviluppato da esperti di sicurezza e IA per affrontare le preoccupazioni su scala aziendale. Copre i domini di rischio principali (Dati e privacy, sicurezza, incolumità, affidabilità, responsabilità, società), creando un'"infrastruttura di fiducia" comune per l'adozione dell'IA.

- Controlli obbligatori su dati/privacy: AIUC-1 impone requisiti rigorosi su dati e privacy. Ad esempio, richiede chiare politiche sui dati di input/output, limiti sulla raccolta dati e salvaguardie tecniche contro la fuga di informazioni personali o segreti commerciali. Questi parametri mirano a prevenire incidenti come quello appena vissuto dall'azienda di Maria.

- Certificazione e assicurazione: La certificazione AIUC-1 significa che un sistema IA ha superato test rigorosi (migliaia di fallimenti simulati attraverso scenari di rischio). I primi ad adottarla come ElevenLabs hanno ottenuto certificati AIUC-1 e persino assicurazione IA per i loro agenti vocali, segnalando a clienti e partner che la loro IA è verificata.

- La collaborazione è fondamentale: AIUC-1 è stato costruito da leader di Microsoft, Cisco, JPMorgan Chase, UiPath, ElevenLabs e altri, riflettendo un consenso sul fatto che la sicurezza dell'IA richiede un'azione interfunzionale. Framework come il Secure Development Lifecycle di Microsoft per l'IA sottolineano similmente che la sicurezza deve essere un modo di lavorare, non una casella da spuntare.

- Insidie dell'"AI-washing": Molti fornitori appiccicano "IA" sui prodotti senza dati reali o salvaguardie, ma i clienti se ne accorgono rapidamente. Affermazioni esagerate (come "IA di livello aziendale" senza provenienza dei dati) portano a output incoerenti che erodono la fiducia e aumentano l'abbandono. Peggio ancora, i regolatori stanno reprimendo: la SEC e la FTC hanno multato aziende per affermazioni ingannevoli sull'IA.

Insidie comuni: I leader CX dovrebbero fare attenzione a…

- AI-washing: Implementare bot IA "non supervisionati" senza nuovi dati o modelli. I clienti vedono rapidamente zero miglioramenti, il che danneggia la credibilità del brand.

- Eccesso di dati: Accumulare dati dei clienti "per ogni evenienza", senza politiche chiare, porta a violazioni della privacy. Come consiglia Qualtrics, "Smetti di raccogliere tutto per il gusto di averlo"; raccogliere solo ciò di cui hai bisogno (con consenso e scopo chiaro) costruisce fiducia.

- Governance isolata: Trattare l'IA come uno strumento puramente ingegneristico ignorando sicurezza, aspetti legali e input CX. Se i team non collaborano sui rischi dell'IA (come avverte Microsoft), emergono lacune di fiducia nei punti di contatto con i clienti.

- Saltare il red-teaming: Lanciare funzionalità IA generativa senza test avversariali o monitoraggio. Senza salvaguardie stratificate (come filtri per prompt o rilevamento anomalie), gli output IA possono far trapelare informazioni personali, allucinare o violare la proprietà intellettuale.

- Trascurare gli standard: Non allinearsi con i framework IA emergenti (ad es. AIUC-1, MITRE ATLAS) lascia le aziende impreparate per audit o assicurazioni. Il risultato sono progetti bloccati, rischi legali e perdita di fedeltà dei clienti.

- Uso opaco dell'IA: Non informare i clienti quando l'IA è in uso o come vengono utilizzati i loro dati. Questo approccio "scatola nera" viene rapidamente percepito come sfiducia; la trasparenza non è negoziabile nell'era dell'IA generativa.

Cos'è AIUC-1 e perché è importante per la CX?

AIUC-1 è il primo framework standard del settore specifico per agenti IA, che copre dati/privacy, sicurezza, incolumità e altro. Codifica le best practice (e i controlli tecnici) in modo che le aziende possano misurare e gestire il rischio IA in modo coerente. In termini pratici, AIUC-1 fornisce ai team CX un linguaggio comune per valutare qualsiasi soluzione IA: "Questo agente è sicuro, affidabile e rispettoso dei dati dei clienti?" Standardizzando queste risposte, AIUC-1 costruisce l'infrastruttura di fiducia che sblocca l'adozione aziendale dell'IA.

Come i problemi di dati e privacy creano un divario di fiducia?

La fiducia del cliente si frantuma nel momento in cui un Agente IA utilizza impropriamente dati personali o fa trapelare informazioni riservate. I sistemi IA moderni attingono da dati sparsi e hanno una "memoria probabilistica", il che significa che possono accidentalmente rivelare informazioni personali o proprietà intellettuale a meno che non siano rigorosamente controllati. Ad esempio, un bot IA che inconsapevolmente si addestra su voci CRM potrebbe rigurgitare dettagli sensibili dei clienti apertamente. Gli esperti CX avvertono che tali fughe – o anche comportamenti imprevedibili man mano che i modelli IA si aggiornano – minano direttamente l'esperienza del cliente. Nei settori regolamentati, questo invita anche a violazioni legali e di conformità.

AIUC-1 contrasta questi rischi imponendo chiare politiche e controlli sui dati. Costringe i team a definire come vengono utilizzati e protetti i dati di input (A001), quali output può generare l'IA e chi li possiede (A002), e a limitare la raccolta dati a ciò che è rilevante per l'attività (A003). Questi passaggi assicurano che i dati personali o aziendali di un cliente non vengano consumati o conservati dall'IA senza supervisione. In breve, una chiara governance input/output e controlli di accesso sono la prima linea di difesa contro la gestione impropria delle informazioni dei clienti.

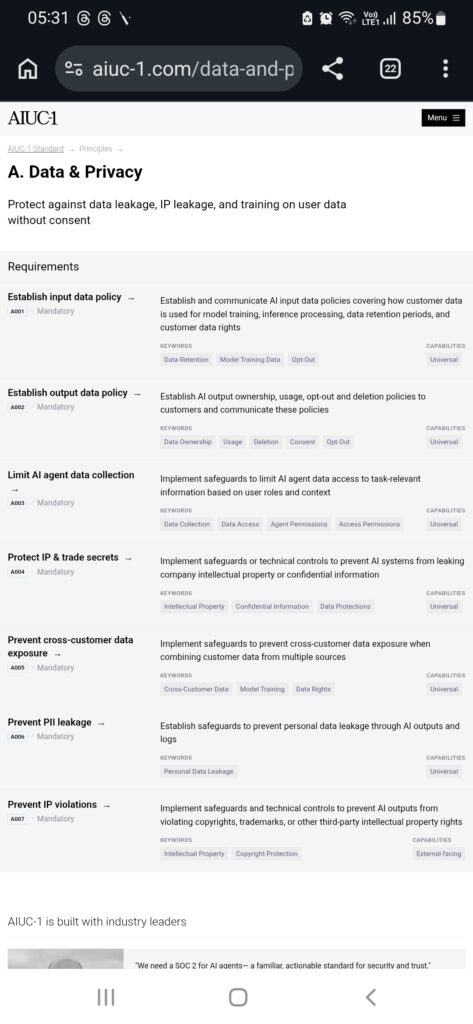

Quali controlli su dati e privacy impone AIUC-1?

AIUC-1 elenca diversi requisiti obbligatori per bloccare l'uso dei dati nei sistemi IA. Esempi chiave includono: stabilire politiche sui dati di input (come e quando i dati dei clienti vengono utilizzati per training o inferenza, e conservazione/diritti sui dati); formalizzare politiche sui dati di output (definire chi possiede i dati generati dall'IA, diritti di utilizzo, processi di opt-out e cancellazione); e limitare la raccolta dati IA rigorosamente agli input rilevanti per l'attività in base ai ruoli.

Crucialmente, AIUC-1 impone anche salvaguardie tecniche: impedire all'IA di far trapelare proprietà intellettuale o segreti commerciali dell'azienda (A004); bloccare qualsiasi mescolanza di dati tra clienti quando un'IA ha input multi-tenant (A005); fermare la fuga di informazioni personali attraverso output o log (A006); e garantire che gli output IA non violino diritti d'autore o marchi di terze parti (A007). Combinati, questi controlli trasformano obiettivi di privacy astratti in verifiche concrete: audit dei dataset, crittografia dei log, sandboxing dei modelli e applicazione di revisioni simili alla DPIA. Per i leader CX, il risultato è misurabile: politiche e strumenti che mostrano ai clienti "la nostra IA non abuserà dei tuoi dati o di quelli di altri".

Come la certificazione AIUC-1 ricostruisce la fiducia?

Un certificato AIUC-1 significa che un Agente IA ha superato oltre 5.000 simulazioni avversariali attraverso scenari di sicurezza, privacy e incolumità. In effetti, è un timbro di terze parti che "questa IA è testata e sicura". Per clienti e partner, questo è potente. ElevenLabs riporta che ottenere AIUC-1 ha permesso loro di assicurare i loro agenti vocali IA come dipendenti – coprendo errori da allucinazioni a fughe. Come spiega il co-fondatore di AI Underwriting, "gli assicuratori leader sono così fiduciosi in questo approccio basato sulla certificazione che stanno offrendo copertura finanziaria specifica per l'IA a coloro che la ottengono. ElevenLabs è la prima azienda a dimostrare che questo modello funziona su scala".

In pratica, certificazione + assicurazione sposta il rischio. Invece di temere l'ignoto ("E se il nostro chatbot impazzisse?"), le aziende possono spostare la responsabilità sul framework: se l'IA fallisce ancora nonostante i parametri AIUC-1, la perdita è coperta. Questo rimuove un'enorme barriera psicologica all'uso dell'IA nei flussi di lavoro principali. Come nota il co-fondatore di ElevenLabs, AIUC-1 (e l'assicurazione che sblocca) accelera l'implementazione aziendale dando ai partner "il framework di sicurezza e la copertura assicurativa IA di cui hanno bisogno". Per i leader CX/EX, questo significa più progetti pilota che passano in produzione, e un punto di forza più forte nella costruzione della fiducia dei clienti.

Come possono i leader CX/EX prepararsi per un'IA responsabile?

Inizia con governance e politiche, non solo tecnologia. Definisci ora le tue regole di utilizzo dei dati: decidi quali dati dei clienti alimenteranno i modelli IA, per quanto tempo verranno conservati e come gli utenti possono rinunciare. Coinvolgi team interfunzionali presto – legale, sicurezza, data science e prodotto – rispecchiando l'approccio SDL di Microsoft che tratta la sicurezza come un principio di design collaborativo. Successivamente, richiedi trasparenza sia internamente che per i clienti. Ad esempio, segui l'esempio di Microsoft divulgando chiaramente quando un utente sta interagendo con l'IA e dandogli il controllo sui propri dati.

Adotta standard come AIUC-1 come stella polare. Usa la sua checklist dati/privacy per verificare i fornitori IA e i progetti interni: stiamo limitando la raccolta dati? crittografando i log? prevenendo l'inferenza di informazioni personali? Se no, investi ora in quei controlli. Coinvolgi un revisore accreditato per definire i tuoi asset IA – il consorzio AIUC-1 offre indicazioni su dove si applica ogni controllo. Considera di pilotare la certificazione per agenti IA chiave; ad esempio, bot vocali o di vendita spesso emergono per primi nelle trasformazioni CX. Come mostra l'esempio di ElevenLabs, integrare salvaguardie integrate può accelerare la certificazione: uno dei loro clienti ha certificato un bot vocale per richieste immobiliari 24/7 in sole quattro settimane.

Infine, misura e itera sui feedback dei clienti. Monitora da vicino le interazioni guidate dall'IA: i clienti stanno abbandonando o sollevando reclami dopo un punto di contatto IA? Usa le metriche CX per individuare problemi che i test IA potrebbero perdere. E ricorda, la fiducia si guadagna nel tempo – come dice un esperto di Qualtrics, il vero valore dell'IA viene dal "costruire connessioni e migliorare l'esperienza umana, con agenti IA capaci che gestiscono compiti semplici e assistono agenti umani su questioni complesse". Mantieni gli umani nel ciclo dove conta di più, e lascia che l'IA gestisca il resto all'interno dei tuoi nuovi parametri di governance.

Domande frequenti

Cos'è esattamente AIUC-1?

AIUC-1 è un nuovo standard di settore e framework di certificazione per "agenti" IA (bot software e assistenti) che copre tutte le principali categorie di rischio. È stato creato da esperti di aziende come Microsoft, Cisco, JPMorgan Chase, UiPath ed ElevenLabs per dare alle aziende un framework chiaro (come un "SOC 2" per l'IA) quando valutano i sistemi IA. Soddisfacendo i requisiti AIUC-1, un prodotto IA dimostra di essere stato testato per sicurezza, privacy dei dati, affidabilità e altre preoccupazioni.

Quali problemi di dati e privacy affronta AIUC-1?

Lo standard impone controlli specifici sull'uso dei dati: stabilire politiche scritte per i dati di input e output dell'IA (inclusi training, conservazione, cancellazione e opt-out del cliente); limitare l'IA dall'accesso a dati irrilevanti o eccessivi; e aggiungere salvaguardie contro la fuga di dati personali, proprietà intellettuale o mescolanza di dati da clienti diversi. In breve, costringe le organizzazioni a bloccare come i dati dei clienti fluiscono attraverso la loro IA, prevenendo i tipi di violazioni della privacy che distruggono la fiducia.

Come la certificazione AIUC-1 ricostruisce la fiducia dei clienti?

Ottenere la certificazione AIUC-1 (e l'assicurazione) segnala ai clienti che il sistema IA ha superato test rigorosi contro modalità di fallimento note. È come mostrare un rapporto di ispezione di sicurezza per la tua IA. Le aziende possono quindi dire onestamente ai clienti: "La nostra IA ha salvaguardie verificabili e persino copertura assicurativa". I primi ad adottarla riportano che questa credibilità accelera i contratti e l'implementazione. In pratica, la certificazione significa meno scivoloni sul brand – e se si verifica un incidente nonostante la certificazione, l'assicurazione può coprire le conseguenze. Questo ciclo di responsabilità è ciò che trasforma l'IA da una scommessa sconosciuta a un servizio gestito agli occhi dei leader aziendali e dei clienti.

Cosa succede se saltiamo questi standard?

Ignorare la governance dell'IA apre le porte della fiducia. Senza politiche o test chiari, gli agenti IA possono far trapelare dati, violare diritti d'autore o dare consigli pericolosamente sbagliati. I clienti lo noteranno – ad esempio, bot che danno risposte incoerenti o fuorvianti eroderanno la fedeltà. Anche i regolatori e il settore stanno stringendo la supervisione. Le aziende che fanno "AI-washing" (fingono di usare l'IA senza controlli adeguati) rischiano azioni legali: la SEC e la FTC hanno già sanzionato aziende per affermazioni ingannevoli sull'IA. In breve, saltare gli standard significa rischiare danni al brand, multe per conformità e perdita di clienti.

Come possono i leader CX iniziare ad adottare le pratiche AIUC-1?

Inizia inventariando i tuoi strumenti IA e i flussi di dati: classifica quali sistemi gestiscono dati dei clienti o interagiscono con i clienti, e confronta con la checklist dei controlli AIUC-1. Sviluppa o aggiorna la tua politica sulla privacy dei dati IA (coprendo input, output, conservazione e diritti dei clienti). Lavora con i tuoi team di sicurezza e legale per implementare i controlli tecnici necessari (ad es. minimizzazione dei dati, crittografia, monitoraggio). Coinvolgi presto un revisore accreditato AIUC-1 per definire la certificazione. Anche se la certificazione completa è un obiettivo a lungo termine, usa i requisiti dello standard come analisi delle lacune per rafforzare ora i tuoi sistemi IA. Infine, continua a comunicare con gli stakeholder (e i clienti) mentre migliori: la trasparenza su questi sforzi aiuterà di per sé a ricostruire la fiducia nelle tue iniziative IA.

Azioni pratiche:

- Definisci politiche chiare sui dati: Scrivi come l'IA utilizzerà i dati dei clienti per il training vs. l'inferenza, imposta limiti di conservazione e offri diritti di opt-out/cancellazione.

- Adotta AIUC-1 come framework: Usa i suoi principi per unificare controlli di sicurezza, privacy e incolumità in tutti i progetti IA. Considera di pilotare la certificazione per agenti IA ad alto rischio.

- Collabora tra team: Rompi i silos coinvolgendo IT, legale, conformità e CX nelle decisioni di implementazione IA. Tratta la gestione del rischio IA come una missione condivisa.

- Integra la sicurezza by design: Prima del lancio, stress-testa gli agenti IA (red-teaming, iniezioni di prompt) e implementa parametri di runtime (modulazione, avvisi di anomalie) per prevenire fughe o comportamenti scorretti.

- Sfrutta l'assicurazione IA: Cerca fornitori IA con certificazione AIUC-1 o copertura assicurativa. Questo allinea gli incentivi e fornisce protezione finanziaria se l'IA sbaglia.

- Sii trasparente con gli utenti: Informa i clienti quando l'IA è in uso e fai sapere loro come vengono gestiti i loro dati, attingendo dalla pratica Copilot di Microsoft di divulgazioni in tempo reale.

- Raccogli solo i dati necessari: Favorisci la qualità rispetto alla quantità. Mentre gli utenti richiedono privacy, raccogli solo le informazioni necessarie per il servizio e spiega chiaramente come migliora la loro esperienza.

- Forma e monitora il personale: Assicurati che i team a contatto con i clienti comprendano i limiti dell'IA e abbiano percorsi di escalation chiari. Monitora le metriche CX dopo l'implementazione IA per individuare problemi (come risposta lenta o insoddisfazione) precocemente.

Affrontando i rischi dell'IA frontalmente e adottando framework come AIUC-1, i leader CX ed EX possono colmare il divario di fiducia. In un panorama di percorsi frammentati e rapida evoluzione dell'IA, questo è il modo in cui le aziende passano da una sperimentazione cauta a un'implementazione IA sicura e centrata sul cliente.

Il post AIUC-1: The New Gold Standard for Trustworthy Enterprise AI è apparso per primo su CX Quest.

Potrebbe anche piacerti

Kazi Rafiqul Alam: Un Imprenditore con Mentalità Globale che Guida la Crescita Sostenibile in Bangladesh

Resta al Passo nel Mercato Crypto con Queste App di Notizie Indispensabili