45 000 лет на обучение Dota 2: Почему современный AI — это просто эффективная зубрежка

Большая часть общества и СМИ считают, что если мы продолжим в том же темпе развивать AI, то мы достигнем AGI. Выходят LLM всё лучше и лучше, значит рано или поздно эти LLM станут такими же умными, как человек! Но если смотреть на мнение учёных в AI, то картина совсем меняется: AGI не будет, пока мы фундаментально не изменим архитектуру.

Масштабирование и новые методы в AI помогают: выходят Claude Opus 4.6, GPT 5.2, Gemeni 3 PRO и другие модели - но это экстенсивный путь. Просто оставаясь на одних трансформерах и других подобных архитектурах мы не достигнем AGI. Это подтверждает «отец глубокого обучения» Ян Лекун:

Приведу пару примеров, чтобы вы поняли, насколько современные ML модели неэффективны:

-

Модель Open Five обучалась всего 45000 лет, чтобы обыграть чемпионов в DOTA 2. Если человеку в среднем надо 20000 часов чистого времени, чтобы стать лучшим, то эта Open Five неэффективней человека в 19710 раз.

-

Чтобы стандартный DQN начал показывать нормальный результат в среде CartPole (балансировка шеста на тележке), то ему в среднем надо 40000 шагов. Человеку же достаточно нескольких минут, чтобы достичь такого же результата.

Чтобы модель начала решать хотя бы немного простые задачи, мы начинаем добавлять к ней разные надстройки, из-за которых модель не решает сама, как ей думать, а думает так, как мы ей сказали:

-

Мы поворачиваем, изменяем яркость картинок (аугментации), чтобы модель выучила разные ракурсы картинок, потому что сама она не понимает, что отзеркаленный по горизонтали объект идентичен изначальному.

-

Добавляем RAG (векторные базы данных), потому что LLM не может запомнить факты и уверенно галлюцинирует.

-

Создаём HRL (иерархическое обучение с подкреплением), потому что обычный RL агент не может соотнести свои действия с результатом в длинных средах с редкими наградами.

-

Делаем промты, в которых буквально умоляем модель думать шаг за шагом, потому что иначе она начнёт совершать логические ошибки.

Но тут многие могут возразить: "Но ведь наш мозг тоже разделён на гиппокамп, мозжечок, зоны Брока и Вернике. Разве не будет хорошо, если мы соберём сами такую архитектуру?" Хороший результат будет, но здесь главное в том, кто создал эту архитектуру. В природе архитектором являлась эволюция, которая подобрала универсальный алгоритм для каждой задачи. В AI же таким архитектором является человек, который не может перебрать миллиарды вариаций для нахождения универсального алгоритма, поэтому он для каждой задачи придумывают новую архитектуру:

-

Для агента-исследователя мы сделаем несколько LLM для генерации гипотез и их проверки.

-

Для сложной среды в RL мы разработаем DreamerV3, который будет представлять исходы каждого события и делать выводы.

Три основные проблемы тупости моделей

AI учёные от Франсуа Шолле до Яна Лекуна выделяют 3 главные проблемы современных моделей:

-

Неэффективность использования данных. Это то, о чём мы уже говорили: 45000 лет на обучение в DOTA 2.

-

Непонимание причин. Нейросети отлично улавливают корреляции. Если в её данных при каждом восходе солнца кричал петух, то при новых данных, где петух не кричит, но солнцу пора вставать, модель подумает, что оно не встанет. Для неё петух и солнце просто часто стояли рядом, нейросеть не понимает, что петух кричал именно из-за солнца.

-

Отсутствие здравого смысла. Для LLM камень — это просто эмбеддинг, который находится рядом с эмбеддингом "тяжело". Модель может не понять, что камни без причины летать не могут, потому что они тяжёлые. Есть статистика позволит, то модель может спокойно сгенерировать без причины летающий камень.

Что такое «фундаментальное решение»?

Перед тем как перейти к архитектурам, существующим на данный момент, для решения этих 3 проблем, надо понять, что такое фундаментальное решение, потому что иногда его очень сложно отличить от костыля.

Ранее уже обсуждалось, что CNN, HRL и другие архитектуры — это правила, которые мы навязали моделям, чтобы они думали так, как мы считаем правильным. Это не решает те 3 проблемы. Архитектура, которая решает эти фундаментальные проблемы, могла бы самостоятельно отрасти себе графовую память, если задача имеет графовую структуру, изобрести трансформеры, если в задаче есть последовательности со взаимосвязями, как сделала бы это эволюция, которая не имея заданного чертежа, сама отрастила мозг, руки и ноги. То есть фундаментальное решение это то решение, которое запрограммировано минимальным количеством правил и которое может изобретать себе самостоятельно специальную под задачу архитектуру.

Но пока ещё нет такой модели, поэтому мы вынуждены под каждую новую задачу «городить огород» из разных методов и правил.

Какие архитектуры пытаются решить эти проблемы

Сейчас уже есть архитектуры, которые пытаются решить эти 3 фундаментальные проблемы. Давайте посмотрим на три самые известные из них.

1. Joint Embedding Architectures (JEPA)

Ян Лекун открыто говорит, что генеративные модели являются тупиковой ветвью для создания контента.

Современные генеративные модели (рассмотрим модели для генерации картинок) предсказывают пиксели. Они вынуждены предсказывать всё, включая очень шумные движения растений и блики на машинах. Чтобы понять, где окажется человек через 5 секунд, вам ведь не надо предсказывать каждый пиксель и каждую мелочь, а просто предсказать движение человека. Архитектура JEPA от Яна Лекуна именно так и пытается генерировать контент. Она игнорирует шум и концентрируется только на семантике.

Результат: Модель учится намного быстрее, потому что она не тратит ресурсы на прорисовку ненужных пикселей. Это шаг к тому «здравому смыслу».

2. Model-Based RL (DreamerV3, MuZero, World Models)

Обычным RL моделям, например, PPO, DQN и A2C, требуется очень много попыток, чтобы что-то понять. Если агент учится паркуру, то он должен прыгнуть с 5-го этажа и разбиться 100 раз, чтобы понять, что так делать не стоит.

В Model-Based RL агент сначала обучает модель мира, которая предсказывает следующее состояние среды после определённого действия. Потом прокручивает в фантазиях тысячи вариаций исходов, обучаясь на них.

Результат: DreamerV3 научился добывать алмазы в Minecraft с нуля, не имея записанных игр людей. Этот агент умирал миллионы раз не в игре, а в воображении. Это большой рост эффективности использования данных.

3. System 2 Deep Learning (GFlowNets)

Даже современные LLM страдают от того, что сходятся к локальному минимуму: они используют одну чаще всего рабочую стратегию, забывая про другие. Это большая проблема, потому что среда в таком случае исследуется очень плохо.

GFlowNets решает эту проблему. Он не застревает в таких локальных минимумах, он пробует всё настолько часто, насколько это выгодно. Простой принцип: "Если A даёт в 2 раза больше пользы, чем B, то я буду использовать A в 2 раза чаще B, но забывать про B не буду".

Результат: Получается модель, которая не так сильно застревает в локальных минимумах и исследует пространство данных намного эффективнее, чем обычные алгоритмы.

Заключение

Сейчас важный этап развития AI, потому что уже всё большая часть мира понимает, что продолжать в том же темпе нельзя. Просто забивать на те 3 фундаментальные проблемы и изобретать трансформеры уже не настолько перспективно.

Инвесторы вкладывают миллиарды и триллионы долларов в надежде, что новая Gemeni 4 PRO окупиться, но в реальности это вряд ли случится. Делать большие датацентры и в том же духе оптимизировать модели не даст суперинтеллект, он даст просто чуть более умную модель. Будущее за архитектурами, такими как TD-MPC2 и JEPA, которые именно и создадут этот суперинтеллект. Я бы сказал, что скоро наступит эра "мозгов", а не эра "масштабирования".

P.S. Об авторе

Я школьник, и моя цель — стать исследователем и создавать AGI.

Мой основной фокус сейчас — RL. Как я уже говорил, RL неэффективен, но это одна из самых красивых идей в ML, где модель учится сама на своём опыте.

Я веду канал RL journey of a teen, в котором пишу о тренировках на ods.ai и kaggle для побед в олимпиадах по ИИ, разработке новых методов в RL и подобном.

Заглядывайте, если интересно следить за путем исследователя с самого начала.

Источник

Вам также может быть интересно

Преодоление глобальных кризисов. Часть 2. Мы подошли к точке сингулярности?

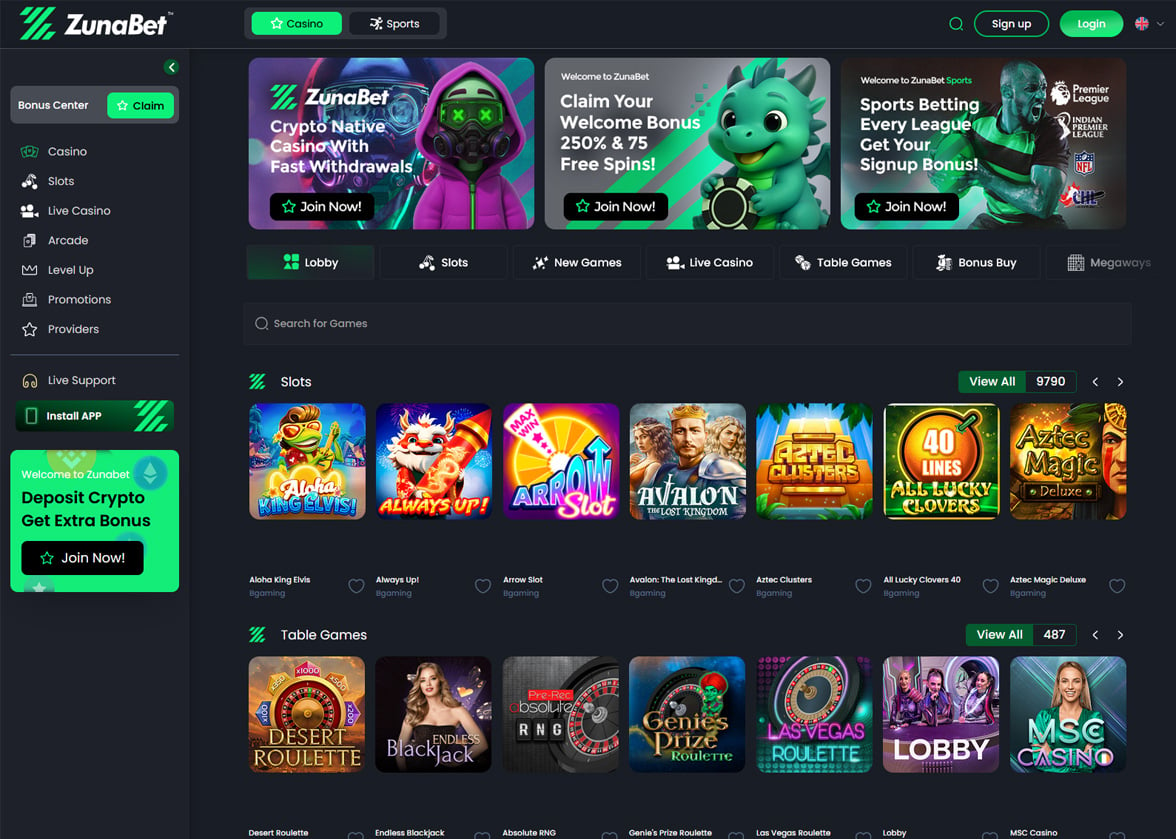

ZunaBet против DraftKings: Крипто-челленджер бросает вызов гиганту